A principios de este mes Google anunció nuevos filtros para Google Lens. Estos nuevos añadidos permitirían analizar con nuestro teléfono el entorno y darnos datos tan valiosos como la carta de un restaurante o sus platos más populares, por ejemplo. Estas características han empezado a llegar a los usuarios aunque con un pequeño rediseño.

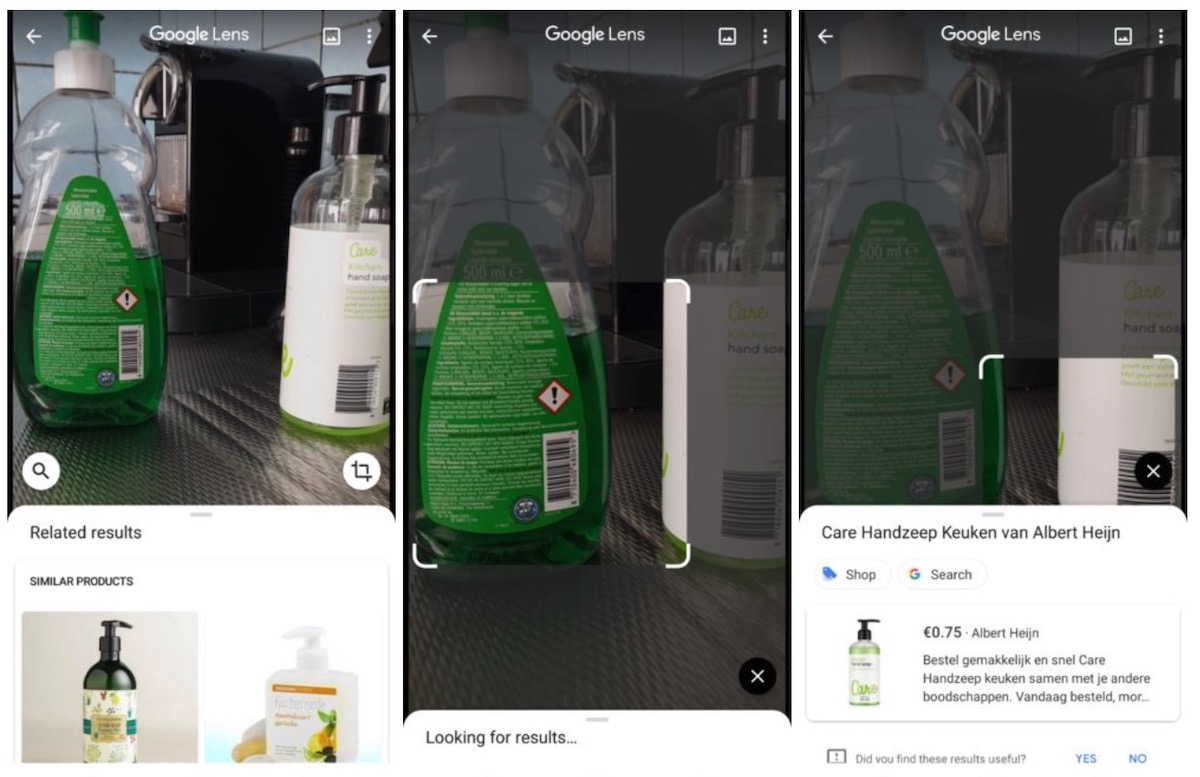

La nueva interfaz de Google Lens puede ser accesible vía asistente de Google o directamente desde Google Fotos. Ahora podemos acceder a 5 nuevos modos que se pueden seleccionar mediante un scroll horizontal. En estos nuevos modos tenemos las opciones: automático, traducción, texto, compras y comidas.

¡SUSCRIBETE A NUESTRO NEWSLETTER!

Cada semana mandamos un único e-mail con el resumen de las noticias a +4.000 suscriptores.

Google Lens añade nuevos modos con Inteligencia Artificial como el de otras marcas

Esto no es para nada nuevo, pues ya hemos visto un funcionamiento similar en asistentes de otras compañías como en Huawei o Samsung. El funcionamiento, de hecho, es muy similar. El modo automático puede analizar qué estamos viendo e identificarlo, aunque no será el más preciso de todos. En los dos siguientes, el modo de traducción, nos permite obtener un texto en nuestro idioma en tiempo real y el modo texto está pensando para exportar letras del mundo real a nuestro smartphone sin necesidad de tener que escribirlas.

Por último, los modos de compras o comidas, pueden analizar más a fondo los productos. El modo de compras es capaz de reconocer objetos a través de sus formas o incluso de sus códigos de barras. La opción comidas lo que hace es facilitarnos los menús de ciertos restaurantes aunque para eso los negocios tendrían que haberse preparado primero.

Las opciones de Lens son muy buenas, pero muchos negocios no están preparados

Estos modos aparecen en un pequeño carousel en la parte inferior de la pantalla y el botón para capturar imágenes no hay que pulsarlo, Google Lens se pone en funcionamiento nada más detectar un objeto delante de la cámara. Otra de las opciones interesantes de este software es que puede analizar las fotos que ya tenemos en la galería y no solo aquellas imágenes que estamos enfocando con la cámara. También es posible seleccionar solo un trozo de la imagen y analizarlo, en caso de que no toda la fotografía sea importante.

Este nuevo rediseño de Google Lens está disponible para la gente que usa Google 9.91 beta, parece exclusiva de los móviles Pixel pero también se ha probado ya en algunos móviles Samsung. Pronto estará disponible para todos tal y como indican en 9to5Google.